Tribunal estabeleceu que redes sociais podem ser responsabilizadas caso não excluam publicações ofensivas após serem notificadas, mesmo sem ordem judicial

O Supremo Tribunal Federal (STF) decidiu nesta quarta-feira (26/6) um longo entrave judicial. Agora, empresas responsáveis por redes sociais e aplicativos devem agir com maior diligência diante de postagens ilegais ou ofensivas feitas por terceiros no país. O descumprimento de uma notificação extrajudicial por parte da vítima ou de seus representantes pode ser suficiente para que essas plataformas sejam responsabilizadas civilmente.

A medida marca uma mudança na interpretação do artigo 19 do Marco Civil da Internet, até então considerado um escudo que só permitia a punição das plataformas após decisão judicial. Com a nova orientação, o STF declarou esse trecho parcialmente inconstitucional, por entender que ele não garante a proteção adequada aos direitos fundamentais, como honra e dignidade.

Veja as fotos

Dias Toffoli votou a favor da responsabilização das plataformasReprodução: YouTube/TV Justiça

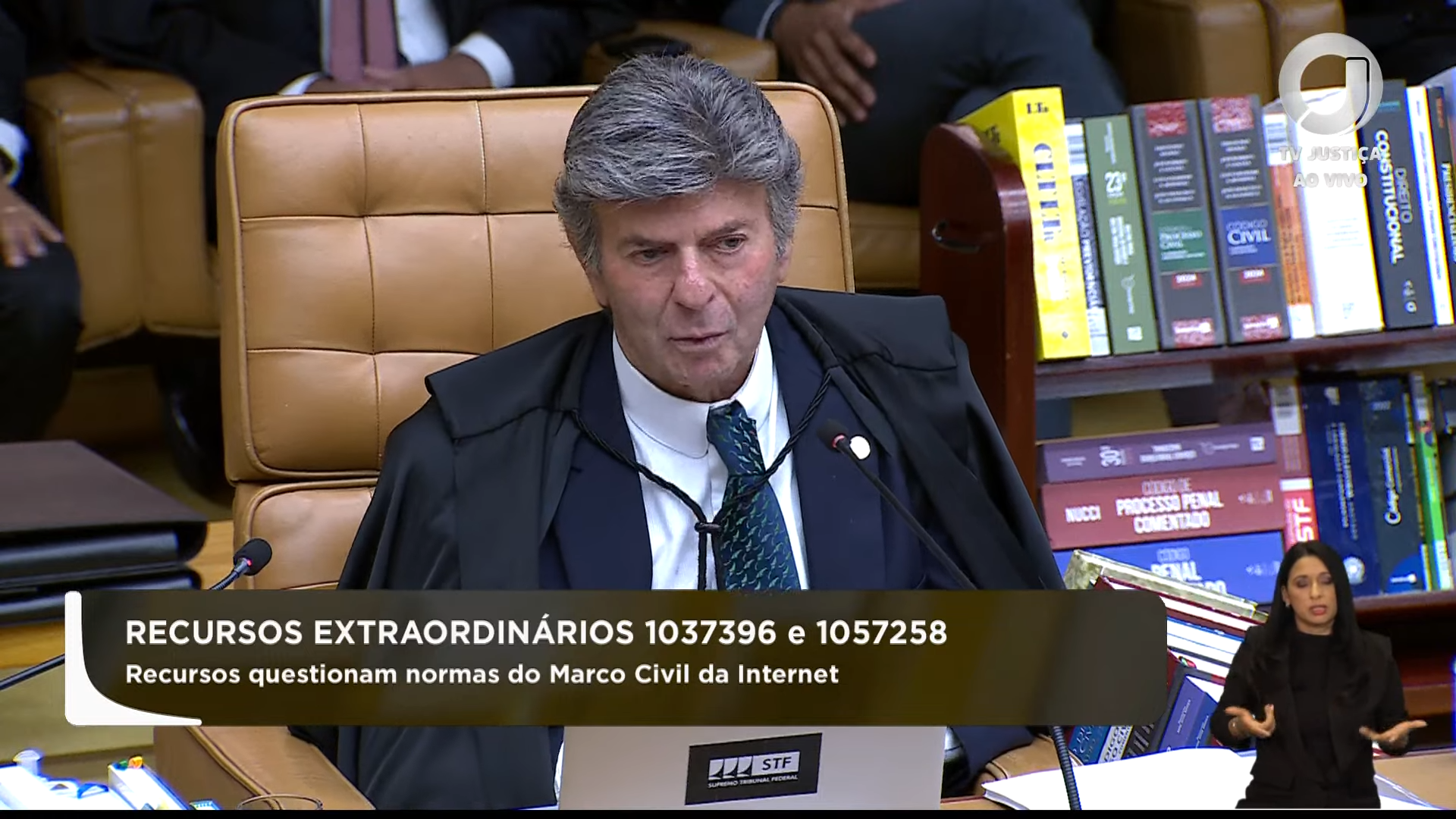

Luiz Fux votou a favor da responsabilização das plataformasReprodução: YouTube/TV Justiça

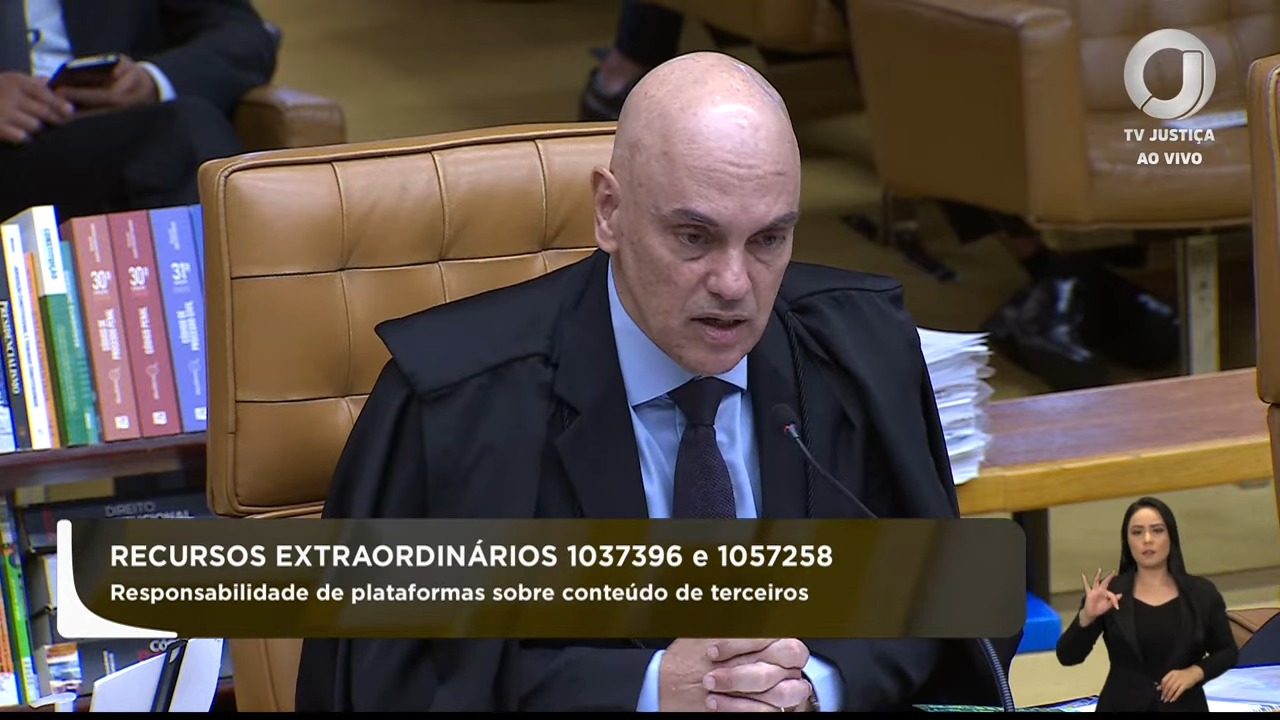

Alexandre de Moraes durante seu discurso nesta quinta-feira (12/6), em que criticou duramente as big techsReprodução: TV Justiça

Luís Roberto Barroso votou a favor da responsabilização das plataformasReprodução: YouTube/TV Justiça

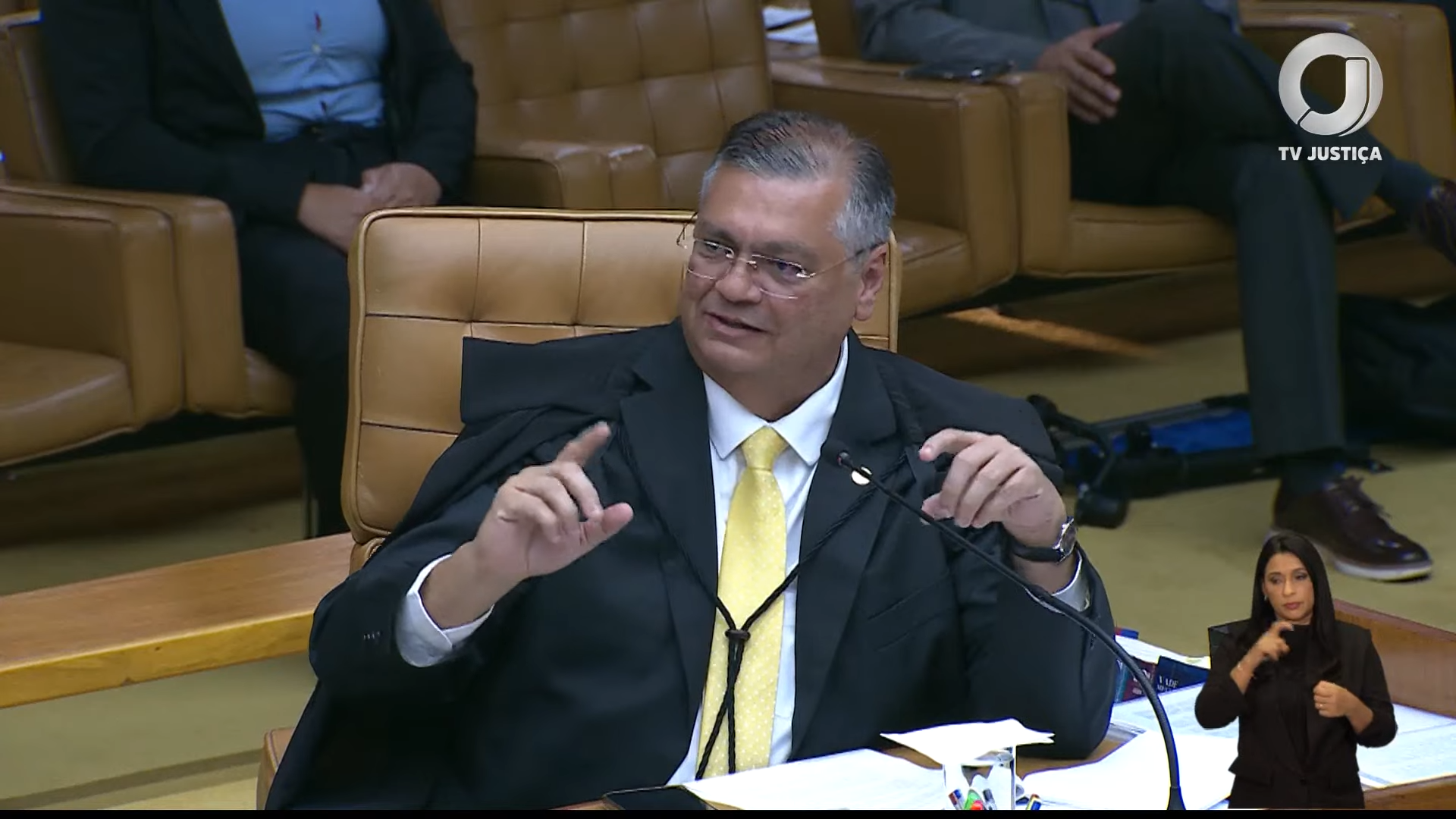

Flávio Dino votou a favor da responsabilização das plataformasReprodução: YouTube/TV Justiça

Cristiano Zanin votou a favor da responsabilização das plataformasReprodução: YouTube/TV Justiça

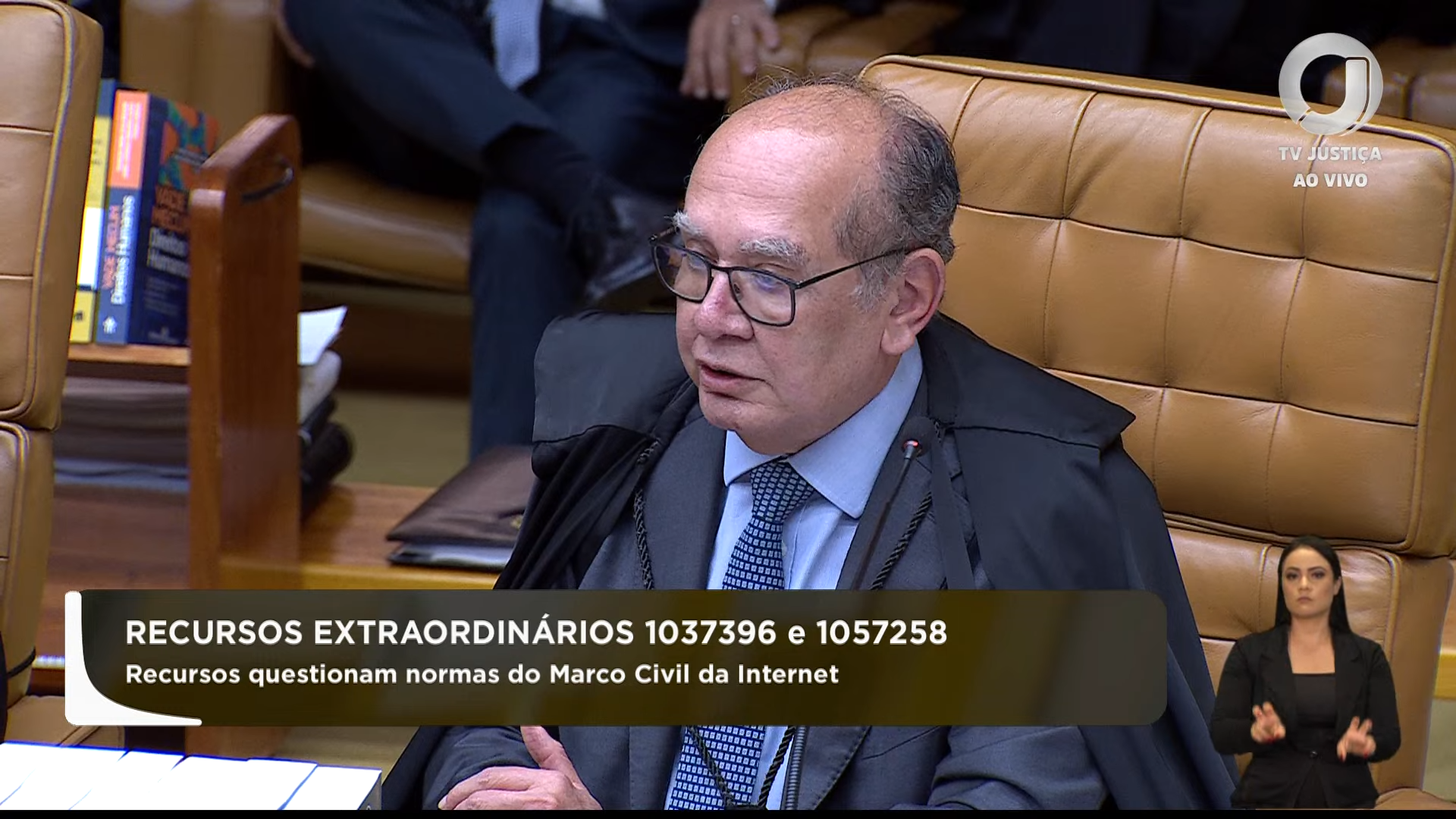

Gilmar Mendes votou a favor da responsabilização das plataformasReprodução: YouTube/TV Justiça

Cármen Lúcia votou a favor da responsabilização das plataformasReprodução: YouTube/TV Justiça

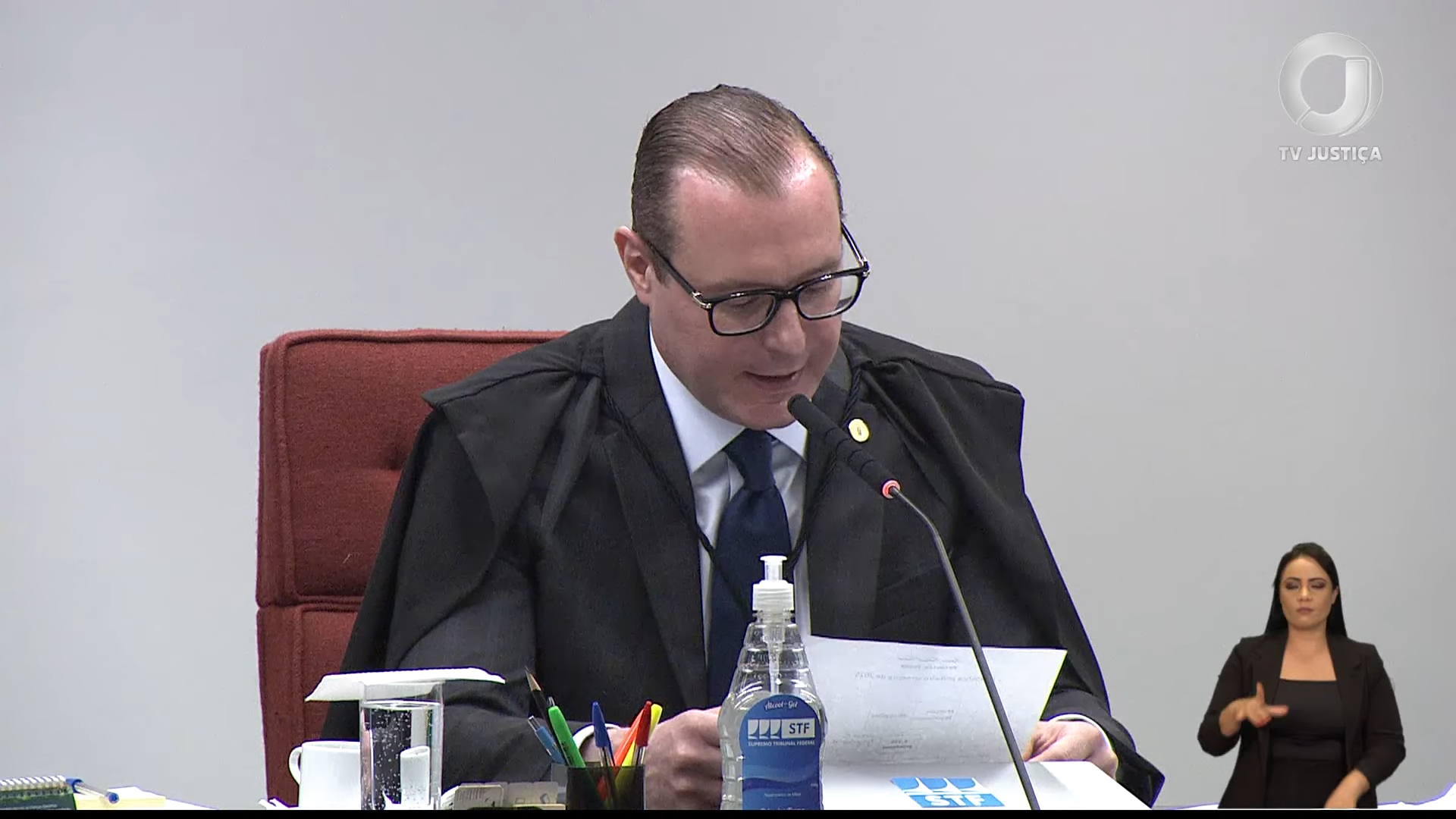

Ministro do STF, André MendonçaReprodução: TV Justiça

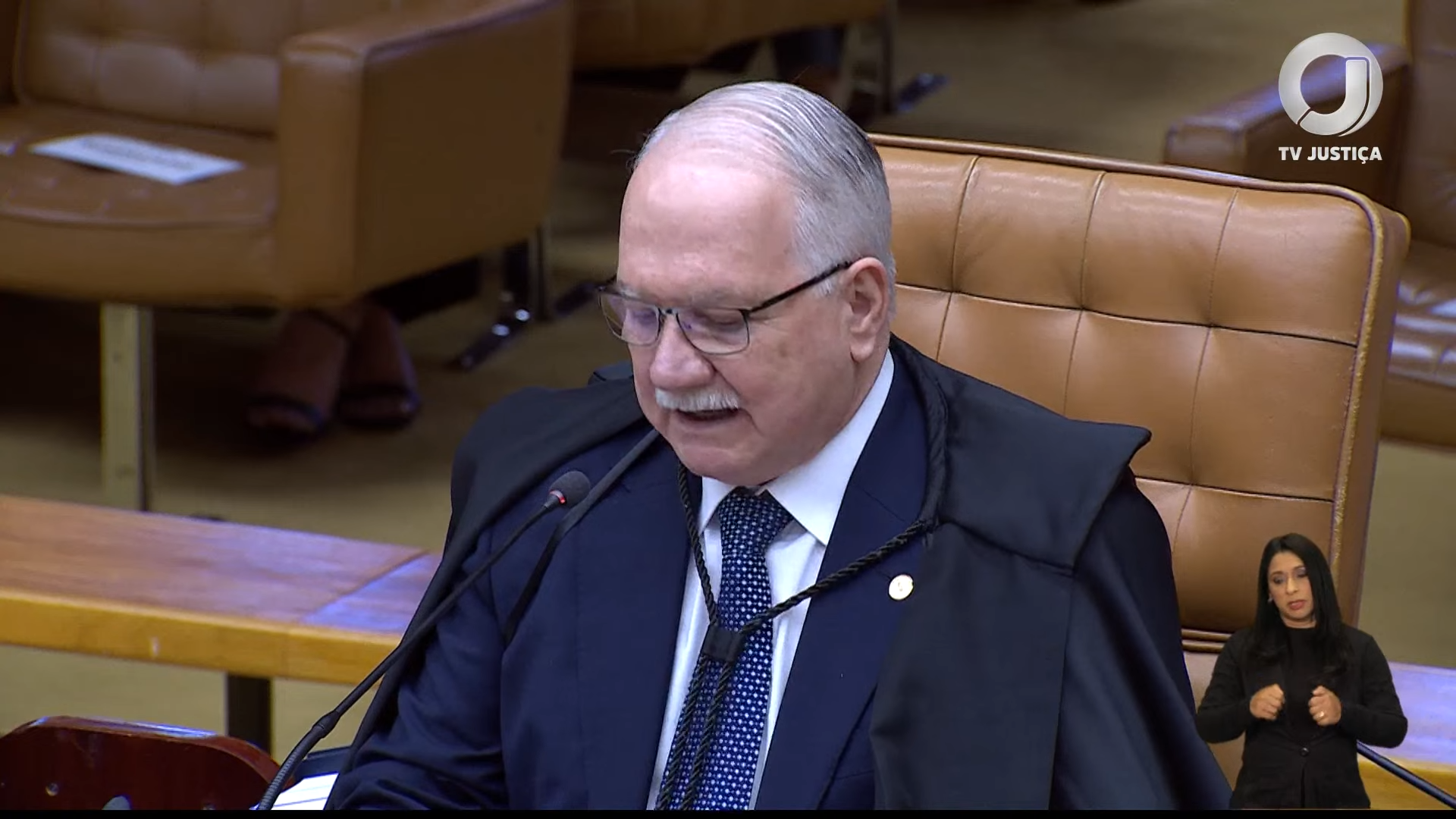

Edson Fachin foi divergente à maioria dos ministrosReprodução: YouTube/TV Justiça

Nunes Marques foi divergente à maioria dos ministrosReprodução: YouTube/TV Justiça

A decisão também estabelece que, em casos graves, como racismo, incitação à violência, pedofilia, terrorismo ou ataques ao Estado Democrático de Direito, as redes devem agir preventivamente, retirando o conteúdo mesmo sem serem notificadas previamente ou sem decisão da Justiça.

A maioria dos ministros votou a favor de uma responsabilização mais ativa das empresas de tecnologia, destacando que a estrutura atual é insuficiente frente ao impacto que as plataformas exercem na sociedade. Para os ministros Dias Toffoli, Luiz Fux, Alexandre de Moraes e outros cinco colegas, o dever de cuidar do ambiente digital exige que as empresas adotem mecanismos de controle mais rígidos.

Já os ministros André Mendonça, Edson Fachin e Nunes Marques defenderam que a responsabilização só deveria ocorrer em caso de descumprimento de uma ordem judicial, por entenderem que qualquer outro modelo poderia comprometer a liberdade de expressão e abrir caminho para a censura.

Com esse novo entendimento, após o julgamento realizado nessa quarta-feira (25/6) e almoço entre os ministros nesta quinta-feira (26/6), o STF determinou que o artigo 19 passe a ser interpretado em conjunto com o artigo 21 do Marco Civil, que trata da responsabilização por conteúdos como divulgação de imagens íntimas não consentidas. Essa ampliação do alcance agora inclui também postagens ofensivas, discursos de ódio e desinformação, com ou sem decisão da Justiça.

A Corte ainda precisa concluir a formulação da tese de julgamento, ou seja, um resumo com valor normativo que orientará juízes e tribunais em casos semelhantes. O texto final deve conciliar diferentes pontos de vista apresentados ao longo das 12 sessões que discutiram o tema.

Essa nova diretriz poderá forçar gigantes da tecnologia, como Google e Meta, a revisar suas políticas de moderação e mecanismos de denúncia, além de abrir precedentes importantes para vítimas de danos virtuais no Brasil.